アーカイブ情報

2026/3/30

【3次元計測・把持計画】東京理科大学、ロボットアームが透明・光沢物体を高速かつ正確に把持する技術を開発

ポイント

・透明な容器や光沢のある包装材など、従来の3次元計測が苦手とする対象物でも、1台のカメラ画像から形状を推定し、ロボットアームが把持できるようにする技術を開発した。

・複数の視点からの観測が必要な場合でも、形状推定の精度と移動距離のバランスを考慮して、撮影位置と移動経路を自動で決定する手法を開発した。

・実機ロボットによる検証で把持成功率96.0%を達成し、従来法と比べてカメラの移動距離を52%、ハンドリング全体の実行時間を19%短縮した。

・同研究成果により、これまで人の手に依存していた工程の自動化が促進され、高精度な把持と効率的な動作の両立により、生産性向上に貢献することが期待される。

研究成果の概要

東京理科大学 創域理工学部 機械航空宇宙工学科の荒井 翔悟准教授、同大学大学院 創域理工学研究科 機械航空宇宙工学専攻のケニス 銀河氏(2025年度 修士課程2年)の研究グループは、透明な物体や光沢のある物体など、ロボットアームによる把持が困難な対象物に対する「3次元計測※1」と「把持計画※2」の手法を開発した。また、ハンドアイ構成※3において、画像撮影のための移動時間と処理時間を削減することに成功した。

従来、透明な容器や光沢のある包装材は、表面での光の反射や透過により深度センサや一般的な3次元計測が不安定になり、ロボットアームによる自動把持が困難であった。そこで同研究グループは、光学特性に左右されにくいRGB画像のセマンティックセグメンテーション※4と、複数視点の輪郭情報から形状を復元するShape from Silhouette※5を組み合わせる手法に着目した。しかし、多視点撮影は精度を向上させる一方、カメラの移動に時間がかかり、製造現場で求められる作業時間(タクト)との両立が課題となっていた。この課題を解決するため、3次元計測の精度向上とカメラ移動距離の短縮を両立するコスト関数を導入し、撮影位置と移動経路を最適化した。

実機ロボットでの検証では、透明・光沢・不透明の物体に対して把持成功率96.0%を達成し、ベースライン方式と比較してカメラ移動距離を52%、ハンドリング全体の実行時間を19%短縮することに成功した。

同研究により、難しい光学特性を持つ物体に対する把持の頑健性と、多視点観測に伴う時間コストの削減を実現した。これにより、ロボットの適用範囲が広がり、製造現場における自動化の推進と生産性の向上に貢献することが期待される。

研究成果は、2026年1月12日に国際学術誌「IEEE ROBOTICS AND AUTOMATION LETTERS」にオンライン掲載された。また、同成果はロボティクス分野のトップカンファレンスである2026 IEEE International Conference on Robotics & Automation(ICRA 2026)にて発表予定であり、世界的な注目を集めている。

研究の背景

ロボットアームは、部品や製品の把持、移載、整列などを自動で行い、工場や生産現場における生産性の向上や人手作業の削減に貢献する装置。近年では、高精度カメラや3次元計測技術の発展により、複雑な作業への適用が進んでいる。しかし、透明な物体や光沢のある物体では、光の反射や透過の影響で3次元計測が不安定になり、自動把持が困難という課題があった。また、対象物の姿勢や位置を正確に把握するには、複数の視点からカメラで撮影する必要があり、計測や処理に時間を要する。その結果、作業タクトの低下やシステム全体の効率低下につながっていた。

そこで同研究グループは、RGB画像によるセマンティックセグメンテーションとShape from Silhouetteに着目した。さらに、3次元計測の精度とカメラの移動距離のバランスをとるコスト関数を導入し、ハンドアイカメラの軌道を最適化することで、精度と効率を両立させることを目指した。

研究結果の詳細

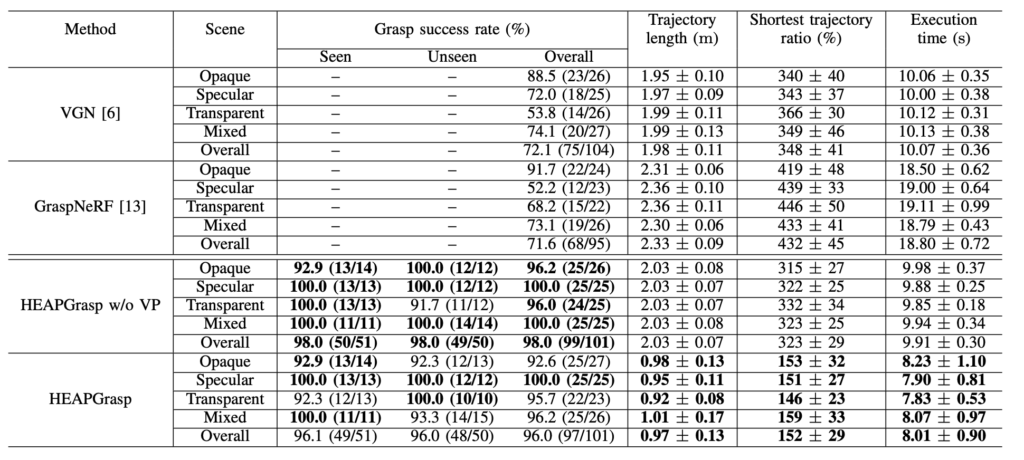

同研究では、従来のベースライン手法(VGN、GraspNeRF)と新たに開発した手法(HEAPGrasp、HEAPGrasp w/o VP)を用いて、実ロボットによる検証を行った。

従来法のVGNでは不透明物体で88.5%の把持成功率を達成したが、光沢物体では72.0%、透明物体では53.8%に低下した。GraspNeRFでも同様の傾向が見られ、不透明物体では91.7%の把持成功率を達成したが、光沢物体では52.2%、透明物体では68.2%に低下した。対照的に、同研究で開発したHEAPGrasp w/o VPとHEAPGraspでは、すべてのカテゴリーで92.6%以上の高い把持成功率を達成した。さらに、学習時に使用していない未知物体に対しても強い汎化能力を示し、それぞれ98.0%と96.0%の把持成功率を達成した。この成功率の差は、主に3次元計測の精度の違いによるもの。

従来法のGraspNeRFは作業空間の周囲に6つの視点が必要なため、カメラの移動距離2.33 m、実行時間18.8秒を要した。一方、同研究で開発したHEAPGrasp w/o VPは、カメラの移動距離2.03 m、実行時間9.91秒に短縮した。さらに、HEAPGraspはHEAPGrasp w/o VPと比べてカメラの移動距離を52%削減して0.97 m、実行時間を19%削減して8.01秒を達成した。

同研究を主導した荒井准教授は、「製造や物流の現場では、透明トレーや光沢袋など自動化が難しい対象が工程に残り、人の手に頼るボトルネックとなっています。そこで、光学特性に左右されにくく、しかも必要最小限の動きで“見てつかむ”ことを両立する仕組みを形にしたいと考え、本研究に取り組みました。本研究成果は、これまで人手に依存していた工程のロボット化を推進し、生産性向上に貢献することが期待されます。さらに、事前調整を削減した設計により、既存設備への導入や多品種対応が容易になります。将来的には、段取り換えや対象追加が多い現場でも、運用条件に合わせて最適な動作を生成しやすいロボットシステムの実現を目指します」と、コメントしている。

※1: 3次元計測

カメラや距離センサを用いて、対象物の位置や形状を3次元情報(x, y, z)として取得する技術。ロボットが対象物の正確な位置・姿勢を把握し、把持や移載を行うための基盤となる。

※2: 把持計画

3次元計測により得られた形状・姿勢情報に基づき、ロボットが対象物を安定してつかむことができる位置や姿勢を決定するプロセス。

※3: ハンドアイ構成

ロボットの先端(ハンド)にカメラを搭載し、カメラの視覚情報を基に、ロボットの動作を制御する仕組み。

※4: セマンティックセグメンテーション

画像中の各画素を物体や背景などの意味的なクラスに分類する画像認識手法。対象物の領域を画素レベルで抽出できるため、3次元計測や把持計画における対象物認識の精度向上に用いられる。

※5: Shape from Silhouette

複数視点から取得した対象物のシルエット画像を用いて、3次元形状を推定する手法。対象物の内部形状を再現することが困難な反面、比較的計算が単純で、対象物の外形を安定して復元できるという特徴がある。

論文情報

雑誌名:IEEE ROBOTICS AND AUTOMATION LETTERS

論文タイトル:HEAPGrasp: Hand-Eye Active Perception to Grasp Objects with Diverse Optical Properties

著者:Ginga Kennis and Shogo Arai

DOI:10.1109/LRA.2026.3653331

- カテゴリー

- コンバーティングニュース